6 zagrożeń dla firm, które generuje ChatGPT

„ChatGPT jest podatny na halucynacje” - ostrzega analityk. Firmy, które zignorują ryzyko, mogą mieć duży problem.

ChatGPT może wydawać się doskonałym narzędziem ułatwiającym pracę, jednak zapobieganie problemom, jakie może wywołać, niekoniecznie będzie łatwe.

Są kontrektne zagrożenia dla firm, związane z korzystaniem z ChatGPT i innych narzędzi do dużych modeli językowych (LLM). Dyrektorzy ds. prawnych i zgodności powinni ocenić ryzyko i opracować odpowiednie środki, by pracownicy korzystając z ChataGPT nie wpędzili firmy w kłopoty.

Ignorowanie tych zagrożeń może narazić przedsiębiorstwa na konsekwencje prawne, wizerunkowe i finansowe – ostrzega Gartner.

Sześć rodzajów ryzyka, jakie powoduje ChatGPT, którym muszą zająć się liderzy ds. prawnych i zgodności

1 Sfabrykowane i niedokładne odpowiedzi

To może być najczęstszy problem: dostarczanie nieprawidłowych, choć pozornie wiarygodnych informacji.

„ChatGPT jest podatny na „halucynacje”, w tym sfabrykowane odpowiedzi, które są błędne, oraz nieistniejące cytaty prawne lub naukowe” – ostrzega Ron Friedmann, starszy analityk Gartnera. Radzi przygotowanie wytycznych dla pracowników, by robili przegląd wszelkich danych wyjściowych generowanych przez ChataGPT.

2 Prywatność i poufność danych

Wrażliwe albo zastrzeżone informacje użyte w monitach mogą zostać włączone do odpowiedzi dla osób spoza przedsiębiorstwa. W firmie trzeba więc wdrożyć zakaz wprowadzania poufnych danych do publicznych narzędzi LLM.

3 Błąd modelu i wyników

Chodzi o stronniczość danych, której całkowicie nie da się wyeliminować. Może pomóc współpraca z ekspertami merytorycznymi, aby zapewnić wiarygodność danych wyjściowych, audyty w celu ustalenia kontroli jakości danych.

4 Ryzyko związane z własnością intelektualną i prawami autorskimi

ChatGPT jest szkolony na dużej ilości danych, które prawdopodobnie zawierają materiały chronione prawem autorskim. Dlatego wyniki mogą naruszać te prawa. Dyrektorzy ds. prawnych powinni więc śledzić zmiany w prawie autorskim, które mają zastosowanie do danych wyjściowych ChataGPT i wymagać od użytkowników sprawdzania tych danych, aby upewnić się, że nie naruszają one praw autorskich i własności intelektualnej.

5 Ryzyko oszustwa cybernetycznego

ChatGPT jest już nadużywany do generowania fałszywych informacji na dużą skalę. Co gorsza jest podatny na szybką iniekcję, technikę hakerską, w której złośliwe monity przeciwnika są wykorzystywane do nakłaniania do wykonywania zadań, do których model nie był przeznaczony (np. pisanie kodów złośliwego oprogramowania lub opracowywanie phishingu witryny). Należy informować o zagrożeniach personel zajmujący się cyberbezpieczeństwem firmy w tej sprawie.

6 Zagrożenia związane z ochroną konsumentów

Firmy, które nie ujawnią konsumentom korzystania z ChataGPT (np. w postaci chatbota obsługi klienta), ryzykują utratę zaufania swoich klientów i oskarżenie o nieuczciwe praktyki. Dyrektorzy ds. prawnych i zgodności muszą więc upewnić się, że korzystanie z ChataGPT w ich organizacji jest zgodne z przepisami w tym zakresie, a klientom zostały przekazane odpowiednie informacje.

Podobne aktualności

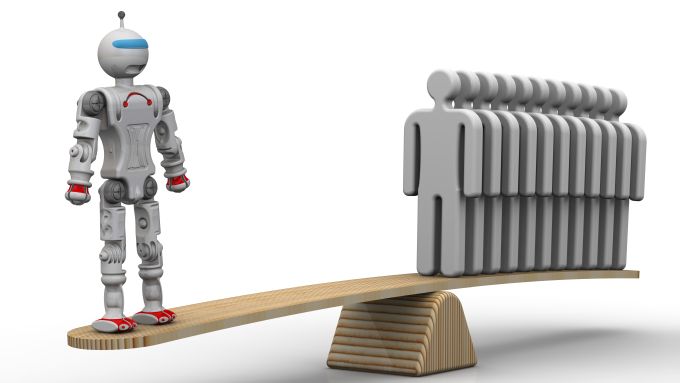

Dyrektorzy będą zwalniać ludzi z powodu AI

Liderami planów redukcji są szefowie ds. łańcucha dostaw. Aż 81 proc. chce odchudzić zespoły z powodu wykorzystania AI.

65 proc. polskich firm nie mierzy efektywności wdrożeń AI

Już ponad jedna czwarta firm w Polsce wdrożyła narzędzia AI, a kolejne 30 proc. zrobi to w tym roku. Jednak większość używających tej technologii nawet nie sprawdza, czy jest ona efektywna.

W Polsce powstała AI Chamber (Izba AI)

„Chcemy reprezentować interesy polskich firm” – zapowiada założyciel i prezes AI Chamber, Tomasz Snażyk. Organizacja wskazuje swoje główne cele.